En el desarrollo de software, la ejecución de pruebas es fundamental para el éxito del producto. Sin embargo, el testing tradicional—tanto el QA manual como el automatizado—presenta desafíos a nivel de costos, precisión y escalabilidad. Es por eso, que la implementación de inteligencia artificial en procesos de testing está en auge, impulsando la efectividad de las pruebas en desarrollo de software.

Hoy, herramientas como ChatGPT y Google Gemini, también usadas por desarrolladores en la generación de código, se han vuelto populares en la creación automática de casos de prueba, optimizando scripts de testing y detectando escenarios que antes quedaban fuera del radar. Combinadas con frameworks como Selenium o Playwright, estas capacidades permiten pasar de un ciclo de pruebas reactivo a uno proactivo y continuo, integrado directamente en pipelines CI/CD.

Retos del testing manual

El testing manual sigue siendo la práctica elegida por muchos equipos de desarrollo. Sin embargo, su implementación puede derivar en cuellos de botella y demoras evitables en la entrega del producto final, además de suponer un esfuerzo humano sostenido y estar sujeto a variabilidad en la ejecución, lo que dificulta mantener una cobertura de pruebas amplia y consistente.

A la hora de implementar un esquema de testing manual, los principales retos se presentan en forma de:

- Largos tiempos de dedicación, ya que cada escenario debe ser minuciosamente verificado por un tester.

- Variabilidad de los resultados, dependiendo de la experiencia individual de cada tester y su background técnico.

- Alto riesgo de pasar por alto errores críticos, ya que no siempre es posible probar todos los escenarios posibles dentro de los plazos estipulados.

En entornos empresariales donde la velocidad y la calidad son críticas, estas limitaciones pueden traducirse en errores costosos y retrasos en el lanzamiento de productos.

Generación automática de casos de prueba con ChatGPT/Gemini

La irrupción de modelos de lenguaje impulsados por inteligencia artificial como ChatGPT y Google Gemini está transformando la forma en que se diseñan los casos de prueba. Estas herramientas son capaces de interpretar requisitos, fragmentos de código o incluso documentación técnica y, a partir de ellos, generar escenarios de prueba de manera automática.

Por ejemplo, a partir de un prompt bien estructurado, estas herramientas pueden generar una lista de casos de prueba funcionales en segundos, lo que reduce de forma significativa el tiempo dedicado a esta tarea. Sin embargo, es indispensable que personal técnico valide y realice ajustes en los casos de prueba, ya que lo generado por IA puede ser incompleto o demasiado genérico.

Ejemplos de prompts

Con ChatGPT o Gemini, puedes generar pruebas generales a partir de requisitos y crear casos de prueba a partir de código, entre otros escenarios.

Por ejemplo, a partir del prompt: “Genera una lista de casos de prueba funcionales para un sistema de login que incluye validación de usuario y contraseña, recuperación de clave y bloqueo de cuenta tras 3 intentos fallidos”; ChatGPT o Gemini devuelve una lista con pruebas como:Verificar login exitoso con credenciales válidas, validar mensaje de error al ingresar usuario incorrecto y comprobar bloqueo tras 3 intentos fallidos consecutivos.

En tanto, con la consigna: “Analiza el siguiente fragmento de código en Java y sugiere casos de prueba unitarios para asegurar la correcta validación de entradas numéricas: [insertar función aquí]”, la IA sugiere casos unitarios para valores válidos, nulos, negativos o fuera de rango.

¿Qué modelo de lenguaje elegir?

En términos comparativos, ChatGPT ha demostrado ser más flexible para prompts conversacionales y ejemplos prácticos, mientras que Gemini destaca en la comprensión contextual y análisis más estructurado.

Esta sinergia abre un panorama en el que la IA actúa como copiloto, acelerando la preparación del testing sin reemplazar la supervisión crítica del equipo de QA.Es importante recordar que estos prompts funcionan como “punto de partida” y no reemplazan la revisión humana, que debe adecuar lo generado a la arquitectura de cada proyecto.

Automatización con Selenium, Playwright y tests unitarios

Los frameworks de automatización como Selenium y Playwright son herramientas consolidadas en el mundo del testing, especialmente en la verificación de interfaces de usuario.

En este caso, al integrarlos con inteligencia artificial, su alcance se expande: la IA puede generar scripts base que simulan interacciones de usuarios, optimizar pasos repetitivos o incluso sugerir validaciones adicionales. Esto permite a los equipos de QA ahorrar tiempo en la creación de pruebas y enfocarse en casos de mayor complejidad.

Además la generación de tests unitarios mediante IA facilita que cada módulo de código sea validado automáticamente desde las primeras etapas del ciclo de vida del software. De esta manera, la combinación entre IA y frameworks tradicionales de testing no sólo acelera los procesos, sino que eleva la confiabilidad de las pruebas.

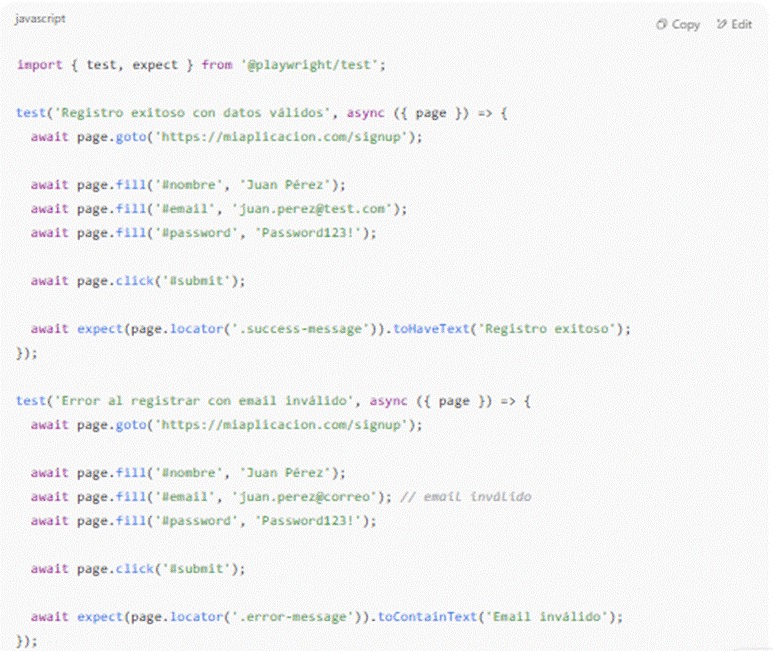

Ejemplo con Playwright (JavaScript/TypeScript)

Con el prompt: “Genera un script de prueba con Playwright para validar que el formulario de registro en https://miaplicacion.com/signup acepta datos válidos y muestra un mensaje de error cuando el email es inválido”, Playwright genera el siguiente código:

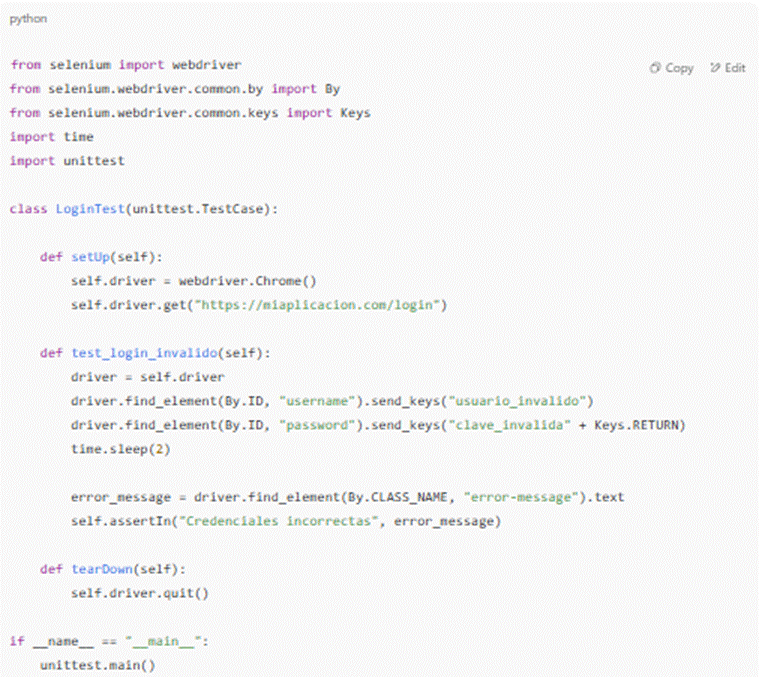

Ejemplo con Selenium (Python)

En el caso de Selenium, frente al prompt: “Escribe un test con Selenium en Python que valide que el login falla con credenciales incorrectas en https://miaplicacion.com/login”, la herramienta devuelve:

Integración del proceso en pipelines CI/CD

Si bien la generación de prompts y código con ayuda de la inteligencia artificial representan un avance en el QA en sí mismos, el verdadero valor de aplicar IA al testing se alcanza cuando se integra en pipelines de integración y entrega continua (CI/CD).

Plataformas como GitHub Actions o GitLab CI permiten ejecutar automáticamente los casos de prueba generados por IA cada vez que se introduce un cambio en el código, asegurando que las validaciones estén siempre actualizadas y alineadas con el estado del proyecto.

A esto se suma la posibilidad de configurar monitoreo y reportes automáticos, que ofrecen retroalimentación inmediata a los equipos de desarrollo y QA. De esta forma, los errores se detectan y corrigen antes de llegar a entornos de producción, minimizando riesgos y garantizando una mayor confiabilidad en cada liberación.

Beneficios: eficiencia, cobertura, reducción de errores humanos

La incorporación de inteligencia artificial en procesos de testing aporta ventajas para las empresas B2B que van mucho más allá de la reducción de esfuerzo manual. Estos son algunos de los beneficios más relevantes:

- Ahorro de tiempo y recursos: al automatizar la generación y ejecución de pruebas, se reduce drásticamente el tiempo invertido en tareas repetitivas, liberando a los equipos de QA para tareas de mayor valor estratégico.

- Mayor cobertura y detección temprana de errores: la IA permite ampliar la cantidad de casos evaluados, incluyendo pruebas límite y escenarios poco habituales que suelen quedar fuera en procesos manuales. Esto asegura que los fallos se identifiquen en etapas tempranas, antes de que impacten en la producción.

- Consistencia en la calidad del software: a diferencia de las pruebas manuales, donde los resultados pueden variar según la experiencia del tester; las pruebas automatizadas con IA garantizan uniformidad y repetibilidad.

Conclusión

La inteligencia artificial está transformando el testing de software en cada nivel: desde la generación automática de casos de prueba con ChatGPT o Gemini, hasta la ejecución en frameworks como Selenium y Playwright, y su integración fluida en pipelines CI/CD.

Para organizaciones B2B que buscan mantenerse competitivas, incorporar IA en sus procesos de validación es una necesidad estratégica, que resulta en software más confiable, ciclos de desarrollo más ágiles y clientes más satisfechos. ¡Transforma tu flujo de calidad en una ventaja competitiva!